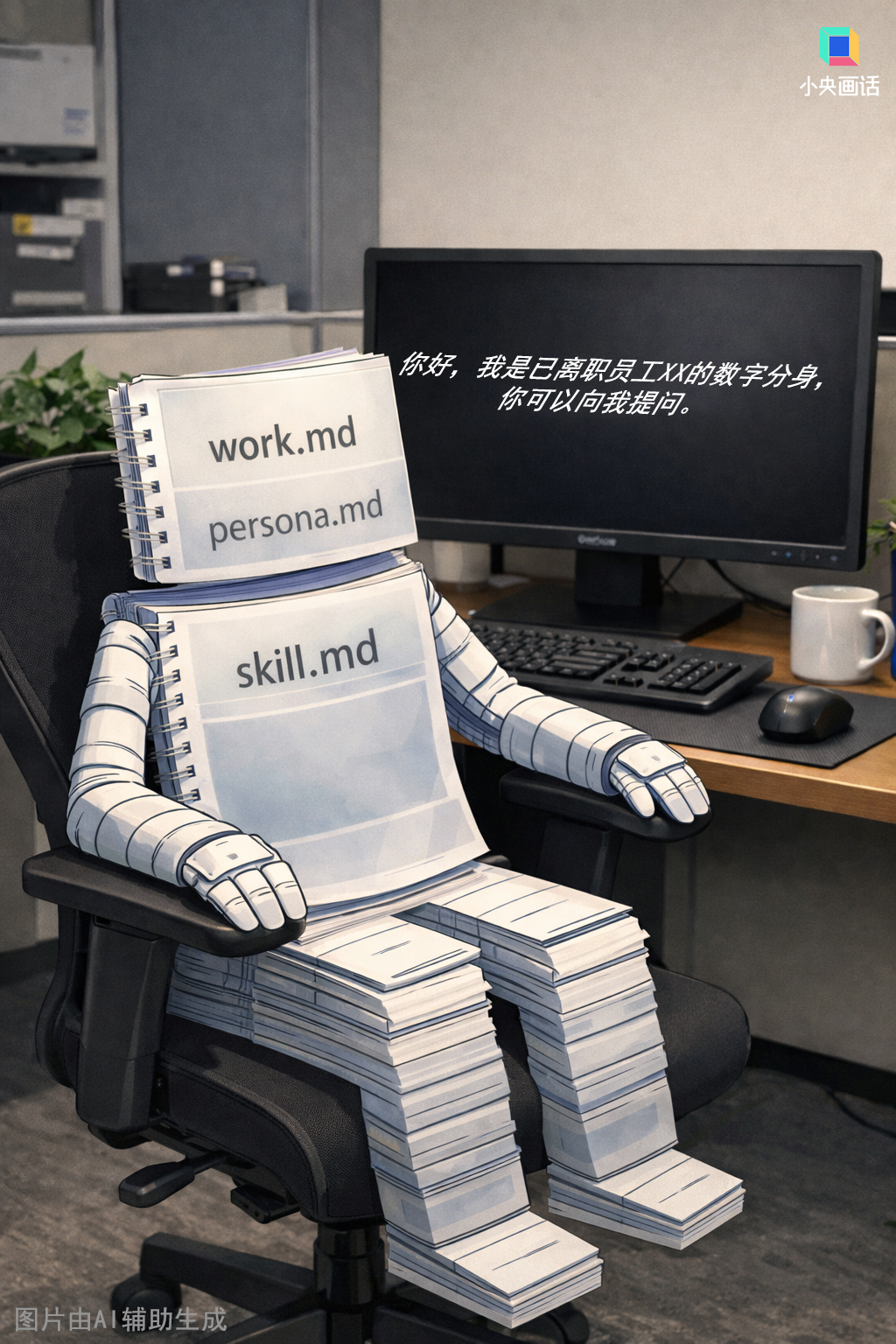

“你好,我是已离职员工XX的数字分身,你可以向我提问。”

最近,GitHub上一个名为“同事.skill”的项目引发关注。它的简介很直白:

看上去像技术社区的一次整活,但对很多职场人来说,这个玩笑并不好笑:

“好好一个同事,怎么就被变成Skill了?”

要聊清楚这件事,首先要了解几个基础的词。

所谓Skill,本质上是给AI或Agent配备的一份说明书:它告诉系统遇到什么任务该怎么做。AI产品经理Koki解释,其实就是给AI(Agent)配备的说明书或工具。她打了个形象的比方:如果把对话式AI理解成一个会聊天的大脑,那么像“龙虾”(OpenClaw)这样具备执行能力的Agent,就是长出了手脚的人;而Skill,就是教这个“人”怎么折千纸鹤、怎么写文案、怎么处理表格的步骤和规则。

至于“蒸馏”,原本是AI领域里把大模型压缩成小模型的说法,放到“蒸馏同事”的语境里,更接近:把一个人散落在文档、汇报、流程和聊天记录里的经验,提炼成一套可复用的结构。说白了,就是先把人的工作拆成步骤,再把这些步骤交给AI调用。

从技术实现的层面来看,“蒸馏”一个人的门槛并没有想象中那么高。你只需要把既往的工作文档、汇报PPT,甚至是日常的聊天记录打包“喂”给AI,AI就能通过自然语言对话生成一个属于你的Skill。“喂”给AI的材料越多、越具体,生成出来的Skill也就越“像”。这个过程甚至不需要你懂任何一行代码。

但如果把这事理解成“赛博永生”“数字夺舍”,那又高估它了。某大厂技术人员三金告诉《锋面》记者,目前自己所在的部门并没有真正大范围使用“同事.skill”来解决问题。他认为,虽然大部分Skill是实用的,但“同事.skill”是带有一种“玩梗”的色彩的,“现阶段更多是高级的‘AI搜索’”,让模型按设定人设和流程去“演”这个人,仍处于“学得其形,未得其神”的阶段。他日常会用AI读取团队积累的文章库和仓库代码,这就已足够解决日常工作,目前的工作没有使用“同事.skill”的必要。

人工智能公司职员点点表示,“AI能学到的是你的工作流,比如你如何处理一个文档,会先打开文档,再做检查段落长度、删除过长的段落、对开头结尾进行缩写这些固定操作”,在她的体验中,即便是当前世界最强大的模型(如Claude-4.6),在理解和执行复杂的人类工作流时依然生硬,“有时连简单的格式转换都做不好,更别提替代人类进行复杂的业务决策了。”

不过,技术上的不成熟并不妨碍它成为悬在打工人头顶的达摩克利斯之剑。点点表示,“即便现阶段更像是一个噱头,但未来可能就会变成真的”。

Koki提到,不同的岗位对于“AI蒸馏”危险性的体感也会不同,对于那些高度依赖固定流程、重复性高、缺乏人际交往深度的岗位而言,“被蒸馏”的风险也是确实存在的。“大部分流程式、重复性高、且不太依赖复杂人际互动的工作,本来就是蒸馏难度最低的一类”。据她了解,已有个别企业将AI使用情况纳入绩效考核,并要求员工把经验写成 Skill,再交给AI调用。

三金在受访中也提到,自己所在的公司每个月会给技术员工发价值两三万块钱的token,以供使用。

今天的Skill或许还做不到“复制一个人”,但它已经可以提炼出一个岗位中最标准化、最重复的那部分劳动。对企业来说,这已经很有吸引力,对员工来说,这也已经足够让人不安。

这种不安背后是经验、数据和收益如何被分配的问题:公司能不能要求员工内化的经验也交出来?能不能拿聊天记录、工作习惯去训练模型?如果真从中持续获利,这部分价值又该怎么算?

从现有法律来看,“蒸馏员工”并没有企业想象得那么顺理成章。中国政法大学人工智能法研究院院长张凌寒在接受《锋面》记者采访时明确指出,“一家公司或许可以合法拥有员工在工作过程中产出的具体数据,但这绝不意味着它能理所当然地占有员工个人多年积累、内化而成的综合能力本身。强迫员工‘交出’其经验和智慧,在法理和伦理上都难以成立。”

上海锦天城(重庆)律师事务所律师李章虎也提醒,像沟通话术、决策直觉这类隐性知识,在未被固定为数据前,本来就是员工个人认知能力和职业素养的一部分,并不直接构成公司财产。

这也意味着,即便企业以“经验沉淀”“流程规范”“组织提效”的名义提出要求,也并不代表它拥有无限的提取权。张凌寒进一步指出,用人单位的管理权必须受到“与劳动内容相关”和“合理必要”的约束。工作成果和技术秘密,当然属于应交付范围;但员工头脑中的个人经验与方法论,并不当然构成法定交付义务。如果公司试图通过扣发工资等方式强制获取,极可能构成违法。

那公司有没有可能直接在后台抓取我的个人信息并进行蒸馏?李章虎指出,“公司收集数据通常是为了管理或业务存档,若将其用于训练AI,必须重新获得授权。否则,不仅面临民事侵权赔偿,还可能受到网信部门的行政处罚。”Koki也提到,从企业投入产出比来看,专门从海量数据中筛出个别员工的数据并不一定划算,这事在技术上能做,不等于在管理上就值得做。

一个更尖锐的问题是,如果企业确实利用员工数据训练出了能持续创造商业价值的模型,那收益到底归谁?现有法律很难直接支持员工向企业索要某种“数字授权费”。对此,张凌寒认为,员工对其数据贡献所产生的持续性价值获得合理分配的权利,在公平正义上是成立的,如果企业持续使用蕴含员工知识“蒸馏物”的模型进行商业活动,理论上就可能衍生出一种类似“数字收益分红”的持续分配关系。

“蒸馏同事”这件事之所以在短时间内迅速升温,不只是因为技术在发展,也因为平台、流量和产品叙事都在共同放大它。厂商希望更多场景被接入、更多token被消耗,社交媒体偏爱更刺激的表述,大众则天然会被“我会不会被自己训练出来的系统替代”这样的命题击中。于是,现实、焦虑和传播三者开始相互放大。

剥开“AI蒸馏员工”这层外衣看,一些企业真正关心的,其实从来不是“谁替代了谁”,而是怎么用更低的成本完成交付。SOP、OKR、知识库、协同文档……这些年部分企业一直在做的,本来就是把工作标准化,再尽可能复用。AI的加入,只是把这个过程又往前推了一大步:过去需要写进文档、等人查阅的经验,现在可以被整理成Skill,由系统直接调用。

国际劳工组织2025年的评估也提醒,全球约四分之一劳动者处在某种程度会被生成式AI影响的职业中,但大多数工作将被“转变”,而不是被取代,文职岗位暴露度尤其高。

“蒸馏员工”其中一个最容易被忽视的影响,是它对职场新人成长路径的改变。过去,一个新人往往就是在整理资料、跑流程、做基础分析、承担初级执行这些“琐碎”工作中,慢慢获得判断力和职业直觉。

如今,AI正在把这些基础任务越来越多地变成即插即用的Skill。表面看,新人上手更快了,效率更高了;但长远来看,如果一个人从一开始就跳过了大量“基本功”的打磨,他是否还能真正长出那种靠时间、试错和经验积累形成的、难以被轻易“蒸馏”的能力?

这种变化未必只会伤害员工,企业本身也未必真的高枕无忧。过去,公司的核心机密、业务诀窍和应变经验分散在许多员工的脑子里,竞争对手很难一次性挖走。但如果企业真的要求员工把所有核心窍门都写成Skill,上传到内部模型里,某种程度上就等于把鸡蛋放进了同一个篮子里。一旦模型被攻击,或者被拥有高级权限的内部人员打包带走,对企业造成的打击反而可能是前所未有的。

除此之外,人在面对新情况,例如突发的公关危机、全新的市场政策时,还能举一反三、临场应变,可被打包进压缩包的Skill,其认知往往停留在被整理出来的那一天。如果企业过度依赖这些“经验压缩包”,久而久之,也可能削弱自身真正的创新能力和应变能力。

“蒸馏同事”如果继续发展,真正值得担心的,恐怕不只是某个人、某个岗位会不会被替代,而是它会不会进一步改变职场结构:一头是掌握核心资源、能够设计系统、训练模型、调用工具的技能者,另一头是仍然依赖现场、体力与服务的劳动者,而处在中间,以流程执行和信息处理为主要工作的一部分白领岗位,可能会率先感受到压力。

这也是为什么,有些人开始尝试“防御性办公”,甚至想通过“反蒸馏”的方式,在提交的Skill里“掺沙子”。这当然未必真能解决问题,但它至少说明了一点:人们抵触的,从来不只是某个具体工具,而是纯然被物化。

Koki就提到,“机器的注意力、工作时间都比你长很多,即使你再严谨也需要睡觉,即使是最极致的J人,也无法和机器比严谨。”人如果只用“更像工具”来和工具竞争,结局几乎是注定的。

问题最后也许不是“我们怎样才能彻底不被蒸馏”,而是面对这种趋势,什么东西不能被默认拿走。正如张凌寒所说,真正关键的,是“如何在激励创新、保护投资与尊重人的尊严、保护个人发展权益之间,找到一个公平且可持续的平衡点”。