“生活在AI时代,每个人都躲不开算法的控制。我们能做的,是察觉到算法对我们的规训,尽可能了解它的机理,趋利避害,为我所用。”中国人民大学吴玉章讲席教授刘永谋在听到“反算法生活”的概念时这样说。作为哲学家,他思考的问题主要聚焦于AI工具与人之间的关系,尤其关注AI及其应用可能导致的社会风险、伦理风险和技术风险。

刘永谋目前策划出版了学术普及类著作“AI时代三部曲”的前两部《智能革命后的世界:AI技术与人类社会的命运》和《AI性别:日常生活的智慧跃迁》,第三部《AI与人性:AI时代的人心及其安顿》正在创作中。

《新周刊》:如果算法给我们推送我们喜欢的内容,很多人会说“号养成了”。你在生活中,是否会有意识地“养号”?

刘永谋:我没有所谓的“养号”行为。

这种行为会导致“信息茧房”,即AI专门把你喜欢的内容推给你,最后我们听不到别的声音,于是“作茧自缚”了。

“信息茧房”概念提出来之后,信息科学、传播学、法学、社会学等许多领域的学者都进行过实证研究,结果发现它缺乏实证。首先,人不可能只从社交媒体上接收信息,如果你的观点极端,很难说是受什么渠道的信息影响;其次,“你开始很温和,刷短视频半年后就变极端了”,这样的验证实验更难以设计。

总之,学界主流声音认为,信息茧房只是某种担忧,人不可能生活在绝对的信息茧房中。当然,这并不是说信息茧房的说法完全没有根据。

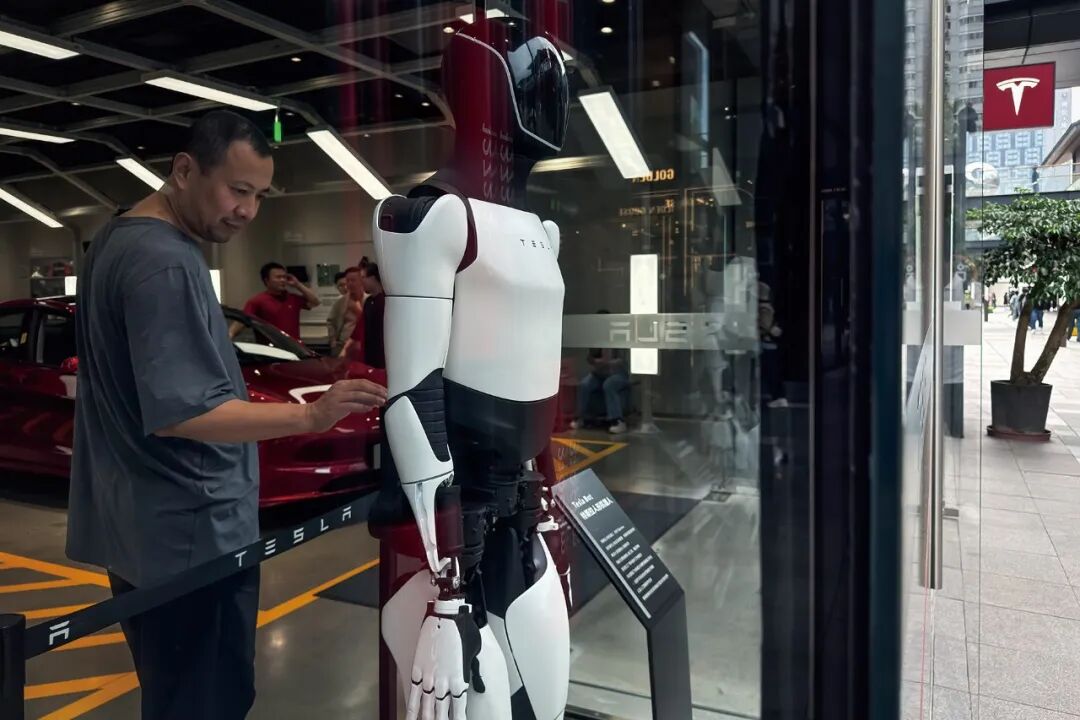

2025年10月18日,四川成都。一名顾客正在仔细观察特斯拉超级工厂展厅内展示的人形机器人“擎天柱”(Optimus)。(图/CFP)

在网络出现之前,报纸、电台、电视台等现代传媒同样给受众推荐新闻内容和传播深度观点。从根本上说,媒体通过议程设置让受众关注某个问题,便是一种“算法推荐”。这些推荐由把关人控制,属于他人推荐。

目前,信息推荐算法常见的有三种:“基于内容的推荐”,即你对什么感兴趣就推荐什么;“基于协同过滤的推荐”,即跟你类似的人喜欢什么就推荐什么;“基于时序流行度的推荐”,即什么流行就推荐什么。我们看到,与受控于把关人的他人推荐相比,算法推荐增加了“自我推荐”,这无疑提高了受众的能动性。

总之,我对信息茧房并没有那么担忧。

《新周刊》:你指出,AI时代会造成新闻娱乐化、平庸化、世俗化。这是为什么?这也和算法有关吗?

刘永谋:网上虚假信息泛滥,一直让人诟病,AIGC(人工智能生成内容)的兴起让情况雪上加霜,因为AI根本没有真假的概念,更没有谁要求它输出的内容必须与真实的世界相符合。长久以来,网络水军肆虐,各种谣言、阴谋论层出不穷;键盘侠满地皆是,上来就站队、开怼、开骂,毫无根据地“灌水”,完全没有耐心,也不想搞清楚事情的真相是什么,“干就完了”。于是,网上的消息不断反转,时常比肥皂剧的剧情还离谱。现在有了GAI(生成式人工智能)工具,开启不拿工资、二十四小时不眠不休的AI水军模式,真相将更加难以寻觅。

此种状况,有人总结为“后真相”。显然,后真相的世界以智能技术为基础。在信息社会到来之前,真相与假象相互混淆,拨开谬误找到真理也不容易。智能技术的广泛应用,大大增加寻求真相的难度,真相与后真相的距离越来越大。

2014年,美联社就开始使用AI协助报道,比如用AI为财经报道处理财务报告,为体育新闻处理比赛得分和比赛笔记。可以说,自此,AI在新闻媒体中的使用开始改变舆论环境。在未来智能社会中,新闻写作越来越依赖于数据,记者从新闻信息采集者逐渐转变成数据管理者和分析者。因此,媒体对复杂新闻事件的理解可能越来越肤浅,公众从媒体报道中则可能了解有限。

随着AI时代的发展,越来越多的网友意识到上网找不到真相,浏览新闻也不再是或者不完全是为了寻找真相,而纯粹是为了娱乐或者宣泄情绪。当AIGC占网络内容的绝大部分后,新闻真假问题就彻底被消解了,加上受众放弃区别真假,新闻报道可能彻底鸡汤化、猎奇化和流量化。

因此,已有偏激的人高呼:“新闻已死!”当然,这种观点过于悲观。AIGC使得真相挖掘变得更困难,但并没有改变新闻意识形态的属性。

《新周刊》:你提出,AIGC会导致“知识的下流”,即知识生产的质量越来越差。AI辅助算法可能加大人们的偏执、自大。你认为算法有类似的问题吗?

刘永谋:对于知识生产而言,AIGC的问题不止于信息泛滥或过载,更重要的是导致“知识的下流”。为什么?大模型以所有网上信息为基础来训练,总体处于这些知识的平均值或中位线水平。因此,AIGC并不是什么高质量的东西。很多人觉得AIGC水平很高,恰恰是因为他们自身的水平在中位线以下。

随着AIGC充斥整个网络,网上少数的优质内容被不断“注水”而“下流”。然后,AI以“下流”后的内容来训练,便会越来越“下流”。有人称之为“garbage in,garbage out”(垃圾进,垃圾出)。

偏见和歧视无处不在。AI算法的问题在于:很多人有AI崇拜和数据崇拜的心理,会觉得AI、数据、算法是公正的、不偏不倚的,从而掩盖了其中的歧视和偏见。

一家黑胶唱片店内,两名年轻人边喝咖啡边听音乐。在音乐平台用算法推荐音乐的今天,很多音乐爱好者回归往日发现、聆听音乐的方式。(图/Zhong)

《新周刊》:我感到很多时候算法体现了“利润最大化”的商业价值观,是这样的吗?

刘永谋:是的。在消费社会,技术与资本一体化,相互支持。一方面,AI技术的研发和推进需要资本的支持;另一方面,资本攫取利润离不开技术进步。可以说,当代资本主义运转以技术创新为基础,没有技术创新,整个经济体系将走向崩溃。

《新周刊》:你提到面对AI和算法,在未来,人会逐渐进入精神分裂和数据倦怠的漫长阶段。能否展开谈谈?

刘永谋:人类学、考古学的研究表明:在驯化家畜的同时,智人本身也开始自我驯化。哺乳动物被驯化之后,出现了一些普遍的解剖学变化,比如体形变小、脑容量减少、耳朵耷拉等,这是某种“幼态延续”,即终生保持幼年期的性状。除了被人类驯化的家畜外,野生动物也有自我驯化现象,典型的比如倭黑猩猩。

回顾历史,智人主动的人种选育行为一直延续至今,比如避免残疾,遗弃残疾者,杀婴,阻止遗传病、精神病病人生育等。此类选育行为的目标,大多是为了繁衍优良后代,减少或者避免劣质后代的出生;也有一些完全是出于文化上的理由,比如中国传统社会男尊女卑的观念导致溺杀女婴的情况,古埃及王室为了保持血统纯正,实行近亲结合(如兄妹通婚、父女通婚等);而20世纪纳粹对犹太人实行的种族灭绝罪行,则是此类“优生学改造”走到极端的疯狂案例。

在人的精神提升方面,人类历史上采取的主要是各种温和的人文宣教活动,比如与智人的出现时间差不多久远的宗教活动、现代以来建制化的识字与教育活动,以及自20世纪开始大规模展开的宣传活动等,均依照类似的逻辑进行。

但是在很多人看来,人文宣教活动的成效并不明显,尤其是很难说智人今日的心灵状况要优于原始人。在法国哲学家卢梭等人看来,原始人才是高贵而纯洁的,而今人既贪婪又堕落。

可以说,文明化意味着对智人越来越严厉的心理和行为压抑。在文明世界中,人类从儿童到成年,要在十数年之内按照社会要求形成足够的自控力和羞耻心,改变人类本性。

随着智能技术的兴起,此类自控驯化将愈演愈烈。近年来兴起的量化自我(quantified self)现象,即用可穿戴设备、传感器等搜集个人在生活中的各种数据,如运动、睡眠、饮食、心情等,其目标是反思和控制自我,属于典型的AI自控驯化。在一定程度上,AI时代的自控驯化可以帮助提升人类道德水平。但同时,它也有隐私暴露、维护成本过高等风险。

从某种意义上说,算法是一种人类自控驯化的技术工具,规训着人类的行为。历史上发生过的对人类自身的改造行为,基本属于群体性选育行为,针对的是对整个人群性状的提升,但是并不能精确控制每个人的改造过程。

随着生物工程、基因工程和人类增强技术的出现并汇聚于智能平台之上,基于新科技的身心设计工程被提上了日程,其目标是精准控制个体的生物性状。比如对胎儿进行唐氏筛查,对人类受精卵进行基因编辑等,通过这些技术手段便可以获得精准的提升效果。也就是说,与身心选育相比,身心设计更为积极主动。也因此,身心设计成了当代智人自我改造的新形式,其最大的特点是作用对象从“人口”(一个群体性概念)转变为“个体”。

很多人担心,过于严格的AI自控驯化,未来会使人多少有一些精神分裂的症状。到处都是摄像头,人需要及时切换自己的状态,人前人后两副面孔。在未来,这种分裂式的表演人格,可能成为生存的基本技能。同时,太过频繁的表演,也可能让人容易麻木和倦怠,最终让人成为另一种智能机器。

《新周刊》:你指出,AI和算法的时代,很大的危险是人的机器化。

刘永谋:从根本上说,智能革命的力量不仅改造自然和社会,更深入到人本身。智人在肉身和观念两个方面正在发生剧烈的改变,某种“新人类”必定在智能革命之后登场。关于未来的人类,之前我认为主要有两种可能,即“赛博格”和“数字人”;如今我认为最有可能是“机器人”,即外表还是人的模样,而身体和灵魂都已经机器化,成为某种智能机器。

(图/Unsplash)

越来越多人开始支持运用新科技对智人肉身进行改造或增强,即我所谓的“身心设计”。他们主要有三个理由:第一,想要在机器人劳动社会中与AI进行劳动竞争,为了避免成为“无用之人”,不得不进行身心设计;第二,AI不断“进化”,加剧智人身心的退化,比如人越来越愚蠢,因此需要用身心设计来遏制退化;第三,未来在与硅基生命的竞争中,作为碳基生命的智人处于明显的劣势,需要身心设计来扭转。

身心设计论者主张的是一条“人的机器化”之路。

“人的机器化”背后是人的主体观念的巨变,我称之为“科学人崛起”。人们不再相信哲学、文学、宗教、神话、巫术乃至迷信的解释,越来越多地求助于新科技对智人研究的新成果,由此,人类行为与情感被还原为物理、化学和生物参数,人性的瑕疵被视为正常的演化缺陷。譬如,爱情不是“少年维特之烦恼”,而是多巴胺、内啡肽等物质分泌的反应。

“科学人”的核心观念在于:人只是一种智能机器,可以也应该被测量、控制和改造。这种观念会逐渐深入人心,接着便是:人要先测量,然后再治理。

关于机器人,未来的“科学人”也许会相信:人形机器挺好的,纯洁而无辜;相反,人类却有一颗被玷污的蒙尘之心。说人像机器一样,将不再是讽刺,而可能成为一种理想。

越来越多人讨论“agent”(能动者),讨论机器人权利。这说明什么?说明大家开始相信,人和机器人均为agent,机器人也有权利,人只是另一种智能机器。这是将人拉平至机器的高度。由此可见:21世纪最大的问题不是AI越来越像人,而是人越来越像机器。

人毕竟不是机器,AI时代人的机器化过程必然要面对人的反抗。比如,我策划的“AI时代三部曲”就是要呼吁大家警惕这种现象。

《新周刊》:你认为在未来,AI、算法等技术的发展会对人类的社会发展产生怎样的影响?

刘永谋:粗略地说,存在两种极端的看法:一种是乐观主义的,认为最终会出现以智能技术为基础的理想国,我称之为“AI理想国”,比如数字共产主义;另一种是悲观主义的,认为最终世界会变成一座大机器,我称之为“AI机器国”。

“AI机器国”会是什么样子?它将是一台严密的智能大机器:每个社会成员都成为这台智能机器上的一个小智能零件,随时可以更换,和钢铁制造的零件没有差别。

一些人认为,新兴的信息与通信技术(ICT)加剧规训化的趋势,当代社会早成了“电子圆形监狱”(electronic panopticon)。显然,这种理论主要考虑的是隐私问题,但智能革命之后,这就不再仅仅是隐私问题,因为除了监视,机器人还会采取行动,比如对人进行拘押。所以,智能技术才可能带来真正的牢狱和“AI机器国”。

“AI机器国”会出现吗?仔细思考一下,“AI理想国”和“AI机器国”的极端想象,都将智能技术视为某种影响社会未来发展走向的决定性力量。

现实远比理想要复杂,更不是非黑即白,而是利弊互现。

现代治理有一个冲动:不光是罪犯,所有人都多少有点问题,都要被改造、被提升。我称之为“完美人梦想”。为了将之落实,当代社会用各种各样的规矩,把每个人随时随地约束起来。显然,这是不可能的,也是可怕的。

执拗于“完美人梦想”,肯定会导致所谓的“过度治理”问题。多数小错误还是应该交还给道德领域,甚至要被社会所容忍。为什么?因为治理必然伴随反抗,试图完全铲除反治理现象,结果一定是系统的崩溃。

江边的草地上,许多市民在周末到此休闲,野餐、露营,或自发组织小型音乐表演。(图/Zhong)

除此之外,伴随智能治理,常见的反治理现象还包括如下几种:第一,智能低效问题。治理智能化是否真的提高了效率?这个问题必须具体分析。有人认为,电脑在社会机构中的使用,未必提高效率,而是掩盖了这些机构需要改进的问题。第二,技术怠工问题。有人利用智能技术来怠工,比如,以学习新的智能技术为借口来怠工,在微信群里找领导,事事请示汇报,推卸责任,等等。第三,智能破坏问题。“人肉搜索”“网络水军”甚至网络造谣,给治理活动带来混乱。对于智能破坏,尤其是机器人犯罪问题,很不好追查。第四,官僚主义智能化问题。现代治理以可计算和文牍中心为基础,可计算指信息数字化,文牍中心要求治理围绕文件展开。治理者治理的是纸上的、数字化的对象,不是真实对象,这就会出现偏差。信息越多,就需要越多机构处理,导致机构不断膨胀。

反治理现象的存在,说明“AI机器国”要运转起来并不容易。

“AI理想国”会出现吗?就算机器人把所有的劳动都包了,一些人也会担心,人类会不会天天打麻将,天天无事生非,自己把自己毁灭了;或者像电影《机器人总动员》中想的那样:人类成了行尸走肉,吃饭都要机器人喂;更重要的是,如何让人类放弃现行的不平等制度,我们为此将付出何种代价呢?

“AI机器国”会出现吗?一些人认为,科技是为权力和当权者服务的。这种观点是错误的,网络的确有利于自上而下的权力监控,但同时也促进了自下而上的网络民主。

既有历史经验表明:人类社会走上极端方向的可能性极小,至善或极恶的理论状态均极少出现,绝大多数情况下社会呈现出有好有坏的现实状态。因此,务实主义者认为,智能治理的未来发展道路究竟是一条什么样的道路,不同国家和地区、不同文化和族群肯定会在具体历史语境中呈现出各自的特色。

排版:莘莘

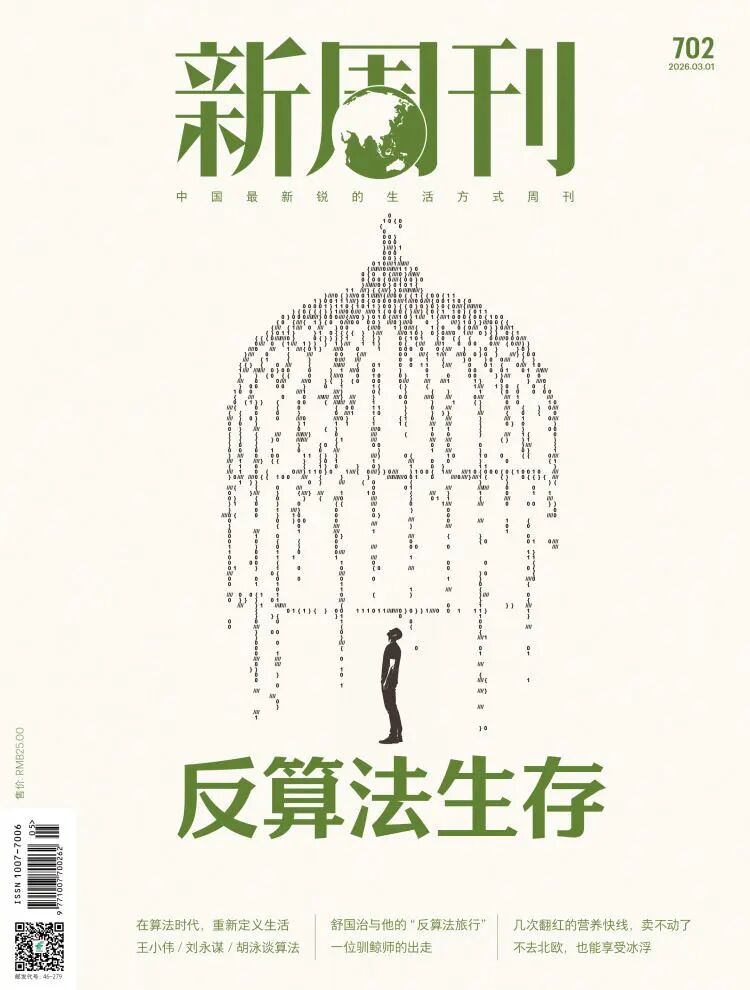

本文原载于《新周刊》总第702期《反算法生存》

原标题:《科技哲学学者刘永谋:最大的问题不是AI越来越像人,而是人越来越像机器》

702期杂志已上市

点击下方图片,即可购买